『シンギュラリティサロン@東京 #23』(10/21(土)) 聴講レポート 報告:小林 秀章

名称: シンギュラリティサロン@東京 第 23 回公開講演会

日時: 2017年10月21日(土) 1:30pm 〜 4:00pm

場所: リコー IT ソリューションズ株式会社本社

晴海アイランド トリトンスクエア オフィスタワー X 42 階

主催: シンギュラリティサロン

共催: 株式会社ブロードバンドタワー、

リコー IT ソリューションズ株式会社

講師: 金井 良太氏 (株式会社アラヤ 代表取締役)

演題: 『人工意識の実現』

講演概要:

意識という主観的な現象も自然現象の一部であるから、自然法則に従っているはずであり、それが生じる何らかのメカニズムが存在するはずである。また、その機能的条件を満たす物理システムであれば、脳以外の物質的基盤からでも生み出すことが可能であろうと予想される。つまり、原理的には人工意識の構築は可能であろう。しかしながら、その本質的な条件が何であるかは、現時点では分かっていない。

心理学や神経科学の研究から浮かび上がってきた意識の機能を分析することによって、意識の本質的な機能は「反実仮想的な状況の感覚表現を内的なモデルに基いて生成する能力」であるという仮説を構築した。これを「意識の情報生成理論」と呼ぶ。

反実仮想の生成過程を現代的なニューラルネットワークによって実装することにより、人工意識のプロトタイプが構築できる可能性があると考えている。(要約: 小林)

定員: 120名

入場料: 無料

http://peatix.com/event/309194

聴講者: 小林 秀章 (記)

【タイムテーブル】

13:30 〜 15:00 金井 良太氏 (株式会社アラヤ) 講演

『人工意識の実現』

15:00 〜 15:30 自由討論

【ケバヤシが聴講する狙い】

意識の謎については、私自身、単なる興味・関心以上の引き込まれ方をしており、今までも、その方面の講演があれば、一も二もなくという思いで聴講してきた。

とりわけ、アラヤの金井氏は、意識のメカニズムの研究において、間違いなく日本のトップランナーであると認識しており、金井氏の発信する情報であれば、著書であれ、ネット上のインタビュー記事であれ、講演であれ、SNS のつぶやきであれ、なんでもかんでもすべて吸収したいという思いがある。思いはあっても、難解すぎて、ぜんぜん追いついていないのだが。

『シンギュラリティサロン』における金井氏の講演は、2017年7月9日(日) に大阪であったのを、すでに聴講している。

http://peatix.com/event/276334

しかし、内容が専門的で、聞いたことのなかった用語がばんばん出てきて、かなり消化不良気味であった。事後に、聴講レポートを書きながらネットで調べたりして、少しだけ理解が進んだ。

なので、たとえほぼ同一内容だったとしても、事前に少しでも知識がある状態で聴講すれば、さらに理解が進むのではないかという期待があった。本来ならば、Karl Friston 氏の自由エネルギー原理を理解するためには、その基盤となっているベイジアン・ネットワークや変分ベイズについて予習しておくべきであるのは分かっていたが、そこまで手が回らなかった。

また、2017年9月23日(土)、新宿住友三角ビル 10 階で開催された『朝日カルチャーセンター』にて、『対談・哲学する人工知能と人工意識』という演題で、三宅 陽一郎氏 (株式会社スクウェア・エニックス) と金井氏の対談があり、聴講した。

その対談では質疑応答の時間が設けられておらず、聴講者からの強い要望に応じて、急遽、別室に希望者が集められたが、ぎゅうぎゅう詰めになった参加者たちから矢継ぎ早に質問が飛び交い、じゅうぶんにディスカッションしきれないうちに、主催者から打ち切られてしまった。

シンギュラリティサロンのいいところは、たっぷり 30 分間、質疑応答の時間が設けられているところが、ひとつある。いつも活発な議論が展開し、もっと長くてもいいと思うぐらいなのだが。

この講演会ならば、日ごろの疑問を金井氏に直接ぶつけることができるで

あろうという期待もあった。

人工知能が人間の知能のレベルを追い越す日をシンギュラリティ (技術的

特異点) と呼び、2045年ごろに来るであろうと、レイ・カーツワイル氏が

予想した。

シンギュラリティサロンを主宰する松田 卓也氏 (天文学者、宇宙物理学者、神戸大学名誉教授) は、カーツワイル氏の予想にほぼ沿った立場をとっている。

人工知能の現在までの進展の延長線上でシンギュラリティが起きるであろうと予想しており、人類の知能を超える人工知能には、必ずしも意識が備わっている必要はないと考えている。

意識の謎が未解明のままでもシンギュラリティが来るのだとしたら、たしかに、数年から数十年のレベルで起きてもおかしくはないと思うが、私自身はその立場に懐疑的である。

意識の備わっていない人工知能では、人間との会話を続けていくうちに、どこかでお里が知れるというか、「お前、プログラムだろ」な感じがぼろっと露呈してしまうのではなかろうかと。

金井氏もやはり、松田氏とは異なる立場をとっていると思われる。そこも、ちゃんと確認をとっておきたいのだが。

人類を超える知能を備える人工知能には、意識が備わっている必要があり、意識のメカニズムの謎を解明することが、まず先決問題だという考えのようである。私も同じ立場である。

しかし、私の予想では、意識の謎は、見かけ以上に深くて、解明までにあと 300年はかかるんじゃないかと思っている。

そこは、金井氏と考えの異なるところで、金井氏は、生きている間に、ネズミ程度の意識であれば、機械に実装できるようになるのではないかと予想しているようである。そこも確認しておきたいポイントだが。

私の 300年説に、根拠があるわけではない。ただ、ロジャー・ペンローズ氏とスティーヴン・ホーキング氏との議論をペンローズ氏の著書で読み、まるで、どの山に登ったら宝が埋まっているだろうか、ぐらいのふもとのところで言い合っているように見え、現時点でこんな調子じゃ、まだまだ当分かかるぞ、と思った次第である。

松田氏、金井氏、私の三者の間の立場の違いは、事前に認識していたので、この話題に触れると議論に火がつく危険性がありそうだが、しかし、興味は非常に高い。

【概要】

まず、松田氏からイントロ。

金井氏の「人工意識プロジェクト」は、国立研究開発法人科学技術振興機構 (JST) の CREST プロジェクトに採択され、予算を割り当てられていることに触れる。2015年9月から 5年半、すなわち 2020 年いっぱいまでに成果を出さないとならない。

あと、300 年じゃなくて、3 年ですよ! と私の 300年説に当てこすってくる。う〜、今ここで論争を始めちゃうわけにはまいりませぬ〜。

金井氏が登壇し、まず、自己紹介から。元・英国サセックス大学准教授。専門は認知神経科学。研究者を辞めて、「株式会社アラヤ」を創業している。

研究畑にいれば、ぬくぬくと安泰な感じではあるが、ちょこちょこと研究成果を上げても、世の中、大して変わりゃしない。もっと大きなことをしたいと思い、起業した。

アラヤのミッションは二つあり、第一に、意識の情報原理を解き明かすこと、第二に、意識を持った人工知能を構築することである。

23 名の社員のうち、17 名が博士号を取得しているという、スーパー頭脳集団。

今回の講演は、大きく 3 つのパートから構成されていた。

パート 1: 意識の問題と、それを科学的に研究することについての話の導入

パート 2: 対象に意識が備わっていることを外から判定するための方法論

パート 3: 機械に意識を宿らせるための方法論

とりわけ、第一のパートである導入部に多くの時間が割かれ、非常にていねいな解説がなされた。意識の問題とは何か、科学で扱うのが適切なのか、なぜ研究する必要があるのか、そういったあたりの序論だ。

そこは重要なところだ。講演者と聴講者との間で話の土台の部分の理解の共有ができていないと、本題に入ってもズレが解消されていかず、悪くすれば、行けども行けども平行線のまま、「黒魔術使いが出てきて、物に意識を宿らせる呪術について話して行かれた」と受け止められて終わりかねない。

重要でありながら、ちゃんと伝えるのがなかなか容易ではないところである。理解を阻む要因がいろいろあるので。

第一に、根源的な問いに限って、問いの意味が理解されづらいというのがある。この手の問いは放ったらかしておいたからといって、日々の生活に支障が出るわけでなし、ふだんから考えていない人が急に聞いても、あたりまえのことをわざわざ難しくしてこねくり回しているようにしか感じられず、いったい何が問題なのか、ピンと来づらいかもしれない。

第二に、意識の問題の特異性がある。意識というと、どうも、テレパシーとか霊魂とか、オカルト系やらスピリチュアル系やらの方面かと思われがちである。宇宙人に拉致されて UFO に連れ込まれたとか、あっちの世界へイッちゃってる系の人たちが言いたい放題の領域である。

科学の側から解明される見通しがまだ立っていない以上、「非科学的だ」と全否定するわけにもいかず、位置づけがむずかしい。かと言って、ごった煮にされても、話がややこしくなって困る。後々合流していくことになるのかもしれないけど、今のところはちゃんと分離しておいたほうがいい。金井氏は、よく怪しい人みたくみられます、と嘆いていた。

第三に、意識を研究対象にすることについて、科学の側からも反対論を唱える人がいるというのがある。よくてもせいぜい哲学の問題であって、科学の守備範囲ではないという主張である。たしかに、意識はまさに主観であって、客観を旨とする科学とは相容れない感じはする。

意識には客観的側面と主観的側面とがある。前者は、外から観察可能な機能的側面であり、「アクセス意識」という。後者は、意識体験の主体によってしか感じることのできない主観的側面であり、「現象的意識」と呼ぶ。

そこらへんをクリアにした上で、意識にまつわる課題には 2 つあることが述べられた。第一に、どうやったら人工的に意識を作り出せるのか、その方法を発見せよという課題である。外から観察したときに、どう見たって意識があるようにしか見えない振舞いをする機械を、どうやったら作れるか、って話である。アクセス意識の創造に対応する。

第二に、対象に意識が宿っていることをどうやって証明するか、その方法を発見せよという課題である。いかにも意識があるように振舞う機械が仮に出来たとして、それに意識があるようにみえるのは観察者の主観であって、実際に意識があることの客観的証明にはならない。そこをどうするか。現象的意識の存在証明に対応する。

話の前後が入れ替わり、第一の課題がパート 3 に、第二の課題がパート 2 に対応する。

パート 2 は、意識の存在を証明するための方法論の話である。ジュリオ・トノーニ氏の提唱する「統合情報理論 (Integrated Information Theory; IIT) が頼りになる。

始めに物質ありきとして、その物質が階層的な構造を持つことによって、複雑な処理が可能になることを説明づけようとするボトムアップのアプローチとは反対方向で、始めに意識ありきとして、トップダウンでアプローチする。

意識があるのなら、当然満たすべき 5 つの公理を設定し、そこから演繹的に論を進める。

人間の脳には 860 億個の脳神経細胞が詰まっているらしい。ひとつの脳神経細胞と別の脳神経細胞との間はシナプス結合でつながっており、それを介して数値を授受している。一個の脳神経細胞は、平均すると一万個ぐらいの脳神経細胞につながっているらしい。

一個一個の脳神経細胞は、たくさんの脳神経細胞から数値を受け取り、それらを入力値として割と簡単な計算をして出力値を算出し、その数値をたくさんの脳神経細胞へと送り出す。一個一個の働きは大したことなくても、配線が複雑であるため、全体として、非常に高度な思考ができている。

これを模して、計算機の上で似たようなことができるようにした人工知能の手法がニューラルネットワークである。

天然の脳にせよ、人工知能にせよ、たくさんの点が散りばめられており、任意の二点間が線で結ばれていたりいなかったりするネットワーク構造が与えられているとき、統合情報理論によれば、その配線のジオメトリ (結合構造) に応じて、Φ (ファイ) という値を算出することができる。

Φ は、ゼロから無限大までの実数値をとる。結合構造が「つまらない」と、Φ の値は小さくなる。

あるネットワーク構造が、意識を宿すほどの情報統合の効率のよさを備えているとき、Φ はきっと大きな値をとるであろうと考えられる。

その逆まで言い切ってしまうと、かなり大胆な仮説となる。あるネットワーク構造の Φ の値が大きければ、そこにはもう意識が勝手に湧いて出てきているのではなかろうか、ってなことに…。いいのか?

人工知能の手法のひとつである深層学習 (ディープラーニング) は、ニューラルネットワークの一種であるが、Φ の値は、計算するまでもなく、ゼロだそうである。そこには意識の湧いてきようがないってことだ。

情報の流れがフィードフォワード (前進方向の伝播) のみでは駄目で、フィードバック (逆方向の伝播) が重要ってことらしい。

Φ は定義はできても、実際に計算するとなると、いわゆる「組み合わせの爆発」という問題に直面し、困ったことになっていた。

Φ を計算するためには、ネットワークを二分割しなくてはならないのだが、その組み合わせの数が多すぎるのだ。点が N 個あると、二分割の組み合わせの数は、2 の N 乗のオーダーで効いてくる。指数関数は嬉しくないのだ。

人間の脳神経細胞のように N が 860 億個もあると、たいへんなことになる。ループの回数が 860 億回になるのではない。その程度だったら簡単だ。ループの回数の桁数が約 300 億桁にも及ぶのだ。仮に、計算機の性能が年々二倍、二倍になっていくとしても、860 億年待たなくてはならないって

ことだ。

この問題に関して、統合情報理論は、いい感じに進化を遂げている。「劣モジュラ性」という性質を仮定すれば、計算量のオーダーが N の 3 乗程度にまで下げられるのだそうだ。これはたいへんな朗報だ。

先ほどは指数関数だったのが、冪 (べき) 関数にまで落とし込めている。多項式時間で計算可能になったってことだ。

さて、ここまで話し終えたところで、3 時まであと 10 分。金井氏「ここまでで、だいたい話の半分なんですけど」。会場からどっと笑いが起きる。メインディッシュはこれからだ。

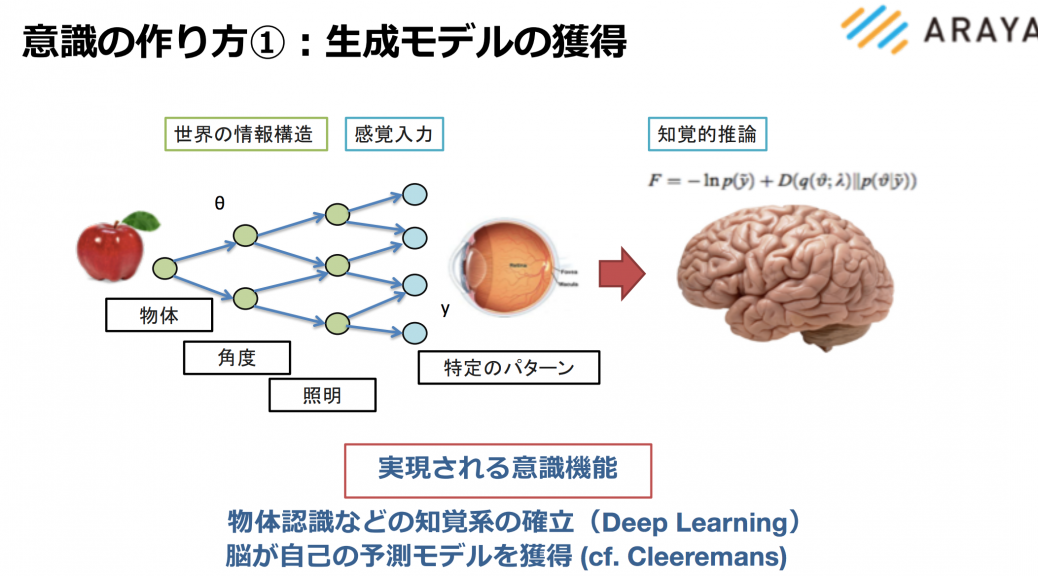

パート 3 は、意識を人工的に作るための方法論の話である。

意識を人工的に作るというのは、つまり、機械の上に意識を宿らせようという話である。言い換えると、意識を備えた機械を作ろうってことである。

そのためには、まず、われわれの意識はいったいどんな機能を果たしているのだろうというのが、要の問いとなる。意識って、いったい何をしてるの?

そこが分かると、それをシミュレートするプログラムを組んでみようという、具体的な試行につながっていく。

その問いに対する仮説として「反実仮想的情報生成理論」というのを打ち出している。この仮説は「意識の機能とは、現実の環境から分離した状況やイベントを表現すること」と言っている。

何を言っているのかお分かりだろうか。私にはさっぱり分からない。… って、それじゃ無責任なので、ケバヤシ流の解説を試みたい (【所感】の項にて後述)。

反実仮想的情報生成理論をちゃんと理解しようとするならば、まず、その下敷きとなっている、Friston 氏の自由エネルギー原理を理解しておかなくてはならない。

しかし、そのためには、さらに下敷きとなっている統計学や機械学習のもろもろの手法を理解していないとならないのだ。期待値最大化法 (Expectation Maximization Algorithm; EM 法) とか、ベイジアン・ネットワークとか変分ベイズとか。「学問に王道なし」で、そこは地道に勉強しておかないと駄目なのだ。

でも、金井氏によれば、そこが理解できると、自由エネルギー原理は「なーんだ、そんなことか」とすんなり入ってくるそうである。よし、がんばるぞ。

最後にまとめとして、三つのことを述べている。第一に、情報生成理論は意識の機能の特徴を取り入れているし、生物学的な知見とも合致していること。第二に、汎用性を備えた人工知能を作ろうと目指す上で、生成モデルが有望であること。第三に、情報生成理論に基づいて構築したシステムは意識を持つと見込まれること。

結論が現時点でかなり難解なのも、仕方のないことと思う。なにしろ、この分野は、謎の解明が進んでいく途上にあるのだ。山だって、登っている途中の道は藪の中で、そんなに見晴らしはよくないのだ。

【内容 … 省略の言い訳】

金井氏が講演で使用したスライドの PDF 版が本サイトにて公開されているので、それをご参照いただければ、講義内容が、ある程度、お分かりいただけるのではないかと思います。

ここに講義内容を記録しても、スライドの情報よりも詳しくはならないので、あんまりご参考にならないんじゃないかと考え、省略します。

【所感】

「反実仮想的情報生成」を自分なりに咀嚼すると、こんなことなんじゃないかと。

テーブルの上、目の前にコップがあり、水が入っている。私はまだこのコップに触れていない。触れてないけれども、触れたらどんな感じか、すでに分かっている。ガラスの冷たくつるっとした感触とか。どの程度の力をかけて持ち上げれば、ほどよい感じに持ち上がるかとか。

実際に持ち上げたとき、思っていた通りになれば、そのことはほとんど意識されない。なので、向かいに座っている人との世間話に興じながら、水を一口飲んで、コップを元に戻すことができる。そして、3 秒後には、水を飲んだことすら忘れている。

しかし、もし、そこに見かけどおりの実体がなく、なんの感触もなく手がスカっとコップをすり抜けちゃったりしたら、そりゃ、びっくりするであろう。雑談は、さしあたってお預けだ。

忘れたころに、同じことをまたやらかしたら、やっぱりびっくりはするだろうけど、一回目ほどの衝撃ではなくなっている。たまにはそういうことも起きうるんだ、ってことを学習して、心に備えができているので。

TJ一郎氏は反実仮想を「仮想 → 実仮想 → 反実仮想」と読んじゃって、バカボンのパパの「賛成の反対なのだ」みたいでわけが分からん、と大混乱に陥っていた。ちがう、ちがう、そうじゃない。「現実に反する仮想」って読むのさ。「だったら、ただの仮想でいいじゃん」。うーん、そうなんだけど。

「仮想」というと “virtual” の訳語として定着しちゃっている。「反実仮想」は英語にすると “counterfactual” であって、別物なのだ。

古文で、「… ましかば … まし」という文型があって。現実はもう A という状態になっていて確定しているのだが、もし A ではなく B という状態になっていたならば、これこれこういうことになっていたであろうに、と、現実に反する仮定の上で物を言うときに使う。これが古文文法の用語として元々ある「反実仮想」である。

網膜に映し出された映像は、電気信号に変換され、まず、第一次視覚野に送り込まれる。そこで処理した結果が、さらに奥 (※) へと送り出される。信号のこの方向の流れを「フィードフォワード (feedforward)」という。

※ ここで言う「奥」とは、次の段階の処理をする領域を指すのであって、頭の中の物理的な位置を示すものではない。

一方、脳の奥のほうで、もしこのコップに触ったらどんな感触が返ってくるかという予測が働き、その予測結果が第一次視覚野に送り込まれる。まだ触れてはいないという現実に反して、もし触れたらどうなるかを予測しているので、反実仮想というわけだ。信号のこの方向の流れを「フィードバック (feedback)」という。

さて、実際、コップに触れたとき、目から入ってくるフィードフォワード信号と奥のほうから返ってくるフィードバック信号とが照合され、差分がとられる。

予測が正しくて、両者にほとんど違いがなければ、差分はほぼゼロとなる。第一次視覚野から出て行くフィードフォワード信号は、この差分だけなのだ。したがって、予測が正しい限り、何も出ていかない。

信号が送られない以上、意識には上りようがないのだ。かくて、雑談はまったく阻害されず、同時並行的に続行される。

実際、第一次視覚野から奥へ出て行くフィードフォワード信号を運ぶ神経の束よりも、奥からそこへ戻ってくるフィードバック信号を運ぶ神経の束のほうが、圧倒的に太いのだ。

さて、予測が大幅に外れたとき、現実との差分が非常に大きくなる。これがドカッとフィードフォワードされる。この差分の大きさが、「びっくり」の大きさになる。びっくりがあるレベルを超えると、意識の側に報告され、それを受けた意識は、雑談を中断して、そっちの処理に注力する。

びっくりするとどうするかというと、次回はこれほどひどい外し方をしないようにと、自分自身の予測機構を調整しなおすのだ。いま起きたことは次回も起きるかもしれないので、予測のうちに含めるようにしておこう。

究極のびっくりは、死んでしまうことだ。安全かと思って歩いていたら、急に野獣が飛び出してきて、ランチにされちゃう、みたいな。それは、実際には安全ではなかったのに、安全だと思い込んでいた、予測の誤りに由来して起きる。

それを未然に防ごうとしたら、あらかじめ小さいびっくりをたくさん重ねておくことによって、知識を豊富に蓄え、それによって予測の精度を高め、危険な状況はそのようにちゃんと察知できる能力を備えておくことだ。

生涯を通じたびっくりの総和をなるべく小さくするように、という動機で行動するのが生存確率を高めることにつながるであろう。後でドカッとびっくりしなくて済むように、今のうちに、ちょっとずつびっくりしておこう。これが、好奇心に相当するのではなかろうか。

その機構を備えるためには、フィードバックが大事だってことだ。いまのディープラーニングはフィードフォワードしかないので、次なる何かがもうじき生まれ出ようとしているってことのようだ。

実際に行動する前に、脳の奥のほうで、行動した結果どうなるのかを常に予測し、フィードバックしている。この予測を立てる働きのことを反実仮想的情報生成という。

生卵をパッカと割って、中身を器に収めたい。生卵を持って、器の縁にコンとやって中ほどの一か所を小さく陥没させて、ひび割れを作り、器の真上に持っていって、ひび割れを下にしたままパカッと開き、中身を落とせばいいのだが。

殻がやけに薄いやつがたまにあって、コンとやっただけでグシャッと潰れ、黄身は壊れ、中身の半分は器の外へデローンと出てしまう。ふんぎゃっ。

ここで難しい問題に直面する。生卵を割るには、叩く際の最適な強さがある。弱過ぎれば割れないし、強すぎればグシャッと潰れる。ところが、殻の強度が卵によってまちまちで、叩く強さの最適値はそれぞれ異なる。なのに、殻の強度はあらかじめ分かっていない。さて、どうすればいいか。

叩く強さが弱すぎた場合は、何も起こらないので、やりなおしがきく。一方、強すぎた場合は、ひどいことになり、もう取り返しがつかない。

正解は、「コココンッ!」と段階的に強くしていきながら何回か叩くことだ。一回目の「コ」でひび割れができたらそこで止めて、二回目の「コ」はやらない。

さて、この答えに至るためには、いくつかのハードルを越えなくてはならない。

第一に、殻の強さには個体差があるってことに気づくことである。そのためには、過去に割った卵の情報を「経験」という形で頭の中に蓄積していかないとならない。それらの平均と分散みたいな統計量を把握しないとならないかもしれない。

第二に、問題の条件を照らし合わせ、案外簡単ではないことに気づくことである。そのためには、それぞれの条件の意味が分かっていないとならない。

第三に、答えをひらめかないとならない。あらかじめ提示されたいくつかの選択肢の中から一番いいのを選ぶタイプの問題ではなく、「コココンッ!」に考えが至るためには、無から有を生み出すような、ちょっとしたひらめきが必要な気がする。

では、外から何も教えなくても、何回か卵を割って、成功したり失敗したりの経験を重ねていくうちに自力で「コココンッ!」の割り方に思い至ることのできる機械が作れたとして、この「卵割り人形」には意識が備わっているはずだ、と言えるだろうか。

なんとなく、言えないような気がする。その程度の問題を解くだけなら、意識なしにもできちゃうんじゃないかなぁ、と。生卵の上手な割り方を自力で習得する問題は、見かけ以上に高度だとは思うけど、しかしそれは問題の程度としてはまだまだ序の口であって、意識ってもっと高度なことをしているんじゃなかろうかと。

反実仮想的情報生成って、意識ではなく、無意識が担当している仕事なのではなかろうか。だって、コップを持ち上げたり、生卵を割ったりする際に、それをするとどうなるのか直前に予想するのは、意識しなくても勝手に脳がやってるんじゃないかと。だからこそ雑談を中断しなくても同時並行的に

できるわけだし。

逆に、意識の側から、反実仮想的情報生成を今だけやめておこう、と意図的にスイッチをオフにすることはできないわけだし。

予測が外れてびっくりしたときにはちょっと意識に上るけど、どう対処せよと意識の側から指示を出すわけではなさそうだし。予測機構の配線の組み換えは、やはり意識の介在なしに、勝手に起きる。

とは言え、進歩していることには間違いなく、フィードフォワード方向の情報の伝達機構しか備えていないディープラーニングに比べれば、反実仮想モデルを組み込んだ機械のほうが、遥かに気のきいた振る舞いをするに違いない。

仮に、単細胞生物程度の小さい意識が備わったとして (って、単細胞生物に小さい意識が宿っていると仮定しての話だが)、そのレベルの意識にまだ欠けているのは、単なる量的なものなのか、それとも質的ななにかがまだあるのか。

量的なものにすぎないのであれば、放っておけば、自分で勝手にどんどん学習して限りなく賢くなっていけるので、もういただいたも同然だ。

しかし、質的に足りないものがあるのであれば、たどり着ける賢さのレベルに限界が見えてきて、肝心なものがまだ備わってないってことになりそうである。そしたら、このモデルでできることの限界ってことで、もっと洗練されたモデルを考え出して、実装してやらないと駄目ってことになる。ひとつ壁を突破したら、まだ次の壁があった、みたいに。

どうも、それなんじゃなかろうかと。突破しても突破してもまた次の壁が立ちはだかり、気がついたら苦節 300 年、仙人になってました、みたいな。私って、悲観的なのかなー。

「掃除しといて」とだけ言っておけば、具体的にどうするかへのブレイクダウンは自力でやってくれちゃうメイドロボットとか、今書いているこの文章を代わりに書いてくれる代筆ロボットとか、出来る日がいつか来るのだろうか。

出来たら出来たで、とんでもないディストピアに陥るぞ、と、やっぱり悲観的なんだけども。

もし万策尽きて、アイデアが枯渇し、途方に暮れてぼーっとするしかなくなったら、研究は死んだも同然となる。しかし、そうなってはおらず、出現した新しい壁に応じてまだまだ試してみたいアイデアがどんどん湧き出てくるのであれば、研究としては生きている。ゴールまでの距離があとどれだけあるかはいざ知らず、とにかく近づいてはいっているのだ。それなら、元気いっぱい、じゃんじゃん試してみるべし。前進あるのみ。

そうやって生きてくのって、もしかして楽しくないだろうか。あのー、私も混ぜていただけたりしないだろうか。あ、勉強はします。明日から本気出す。

おまけの情報。反実仮想的情報生成理論のような、脳の情報処理原理についての仮説をちゃんと理解するためには、どのような基礎理論や機械学習の手法を学んでおくべきなのか。そのためのよい教科書は何か。

産総研の一杉裕志氏が、ご自身のサイトにまとめてくださっている。[脳を理解するための情報源メモ] のページに書いてあることが、ものすごく役に立ちそう。とりあえず、掲載されている書籍は、いろいろポチった。なんか、これから勉強しなきゃならんことが、膨大にあるような。

https://staff.aist.go.jp/y-ichisugi/j-index.html

以上。

=======================================================================

—————–

*講演資料: